هلا نيوز – وكالات

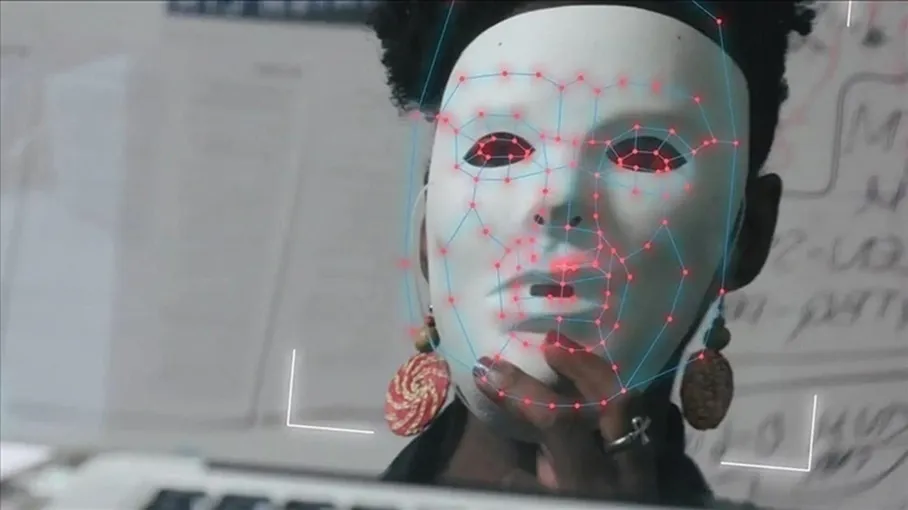

تصاعد دور الذكاء الاصطناعي خلال الأعوام الأخيرة بشكل ملحوظ حيث إنه بدأ بلعب دور مهم في عالم التكنولوجيا، ما سمح له باقتحام العديد من المجالات، منها الأمنية والعسكرية.

ويتهم خوارزميات الذكاء الاصطناعي بالعنصرية بحكم تأثرها بالعامل البشري، فضلا عن استخدامها في الحروب والمعارك، كما يفعل الاحتلال الإسرائيلي في قطاع غزة.

وبات الحديث عن الذكاء الاصطناعي يأتي مصحوبا بمخاوف وتحذيرات منها أمنية، إلى جانب السلوك العنصري الذي بدأت ملامحه تطفو إلى السطح، بحسب وكالة الأناضول.

يقول عضو هيئة التدريس في كلية الطب بجامعة “جراح باشا إسطنبول” التركية، وخبير الذكاء الاصطناعي، إن العامل البشري يفرض سلوكيات عنصرية على خوارزميات الذكاء الاصطناعي.

ويضيف أن “خوارزميات الذكاء الاصطناعي المستخدمة في مجالات مختلفة يمكن أن تقدّم للمستخدم نتائج عنصرية قائمة على التمييز بين البشر”، بحسب حديثه للأناضول.

أصحاب البشرة السمراء

ومثالا على ذلك، فإنه “ذات مرة، عندما كتبت كلمة ape (قرد) في أحد محركات البحث على الشبكة العنكبوتية (الإنترنت)، ظهرت صورة الرئيس الأمريكي السابق باراك أوباما وأفراد عائلته”.

ويؤكد الخبير أن “الذكاء الاصطناعي المستخدم في مجال القانون، يربط الناس أصحاب البشرة السمراء أكثر بعناصر الجريمة”.

وقد تم الكشف مؤخّرًا، وفق المتحدث، عن أن “الذكاء الاصطناعي الذي تستخدمه هولندا في منح تأشيرات الدخول، يقوم بارتكاب جريمة التمييز بين البلدان والأفراد، وحتى الجنس”.

ويذكر كيرشجي أن “العنصرية في خوارزميات الذكاء الاصطناعي تعكس مناهج المبرمجين، أو فهم المجتمع الذي تم تصميم التطبيقات فيه”.

ويضيف أن “الإنسان هو الكائن الوحيد الذي يقوم بتنظيم وبناء هذه العملية برمتها، ويجعل الآلات تتصرف بهذه الطريقة”.

ويلفت المتحدث إلى أنه “ليس من الممكن دائمًا تحديد المكان الذي تعلم فيه الذكاء الاصطناعي هذه السلوكيات العنصرية أو التمييزية”.

ويتساءل: “من يعلّم العنصرية للذكاء الاصطناعي؟ من صممه أم من استخدمه؟ أم من أجرى عليه بعض اللمسات النهائية؟ هناك هيكلية غامضة وراء كل ما سبق”.

ويتابع: “تابعنا المناقشات الجادة في العالم حول الذكاء الاصطناعي وبنية القانون منذ التسعينيات، حيث إنه يتم اعتماد بعض اللوائح القانونية في الواقع لجعل النخب بريئة من حرب الهيمنة الكبرى المطلوب خوضها”.

ويصف ذلك بأنه “عملية قانونية تجبرنا على القتال بجهاز لا يمكننا أبدًا الحصول على رد منه عندما نواجه مشكلة، فلماذا تميز الآلة بين الأسود والأبيض؟ إن من يقوم بهذا السلوك هو في الواقع شخص يتخفى وراء الآلة”.

العنصرية نتيجة التقليد

ويعرّف كيرشجي الذكاء الاصطناعي بأنه “إدخال الذكاء البيولوجي لأجهزة الكمبيوتر أو الروبوتات أو العالم الرقمي، وتمكينهم من تقليده”.

ويشدّد على أن “العنصرية هي نتيجة لهذا التقليد، وليس من المنطقي أن تطوّر الآلة سلوكًا عنصريًا تجاه أي مجموعة من الناس بمفردها”.

ويشير إلى أن “الآلة تصبح قادرة على اتخاذ القرارات ومتابعة العمليات، وتصبح قادرة على تشغيل وظائفها الخاصة عند الضرورة، خلال تعلمها لمحاكاة العمل الذي يقوم به الإنسان”.

وعن قدرات أنظمة الذكاء الاصطناعي، يقول إن تلك الأنظمة “تتمتع بقدرة على العمل بشكل مستقل عن البشر، بل وتنتج طاقتها الخاصة وتحمي نفسها من خلال التفكير بإمكانية أن يقوم أحد ما بفصلها عن مورد الطاقة”.

ويشدد كيرشجي على أن “الآلات ستظل دائمًا أقل قدرة من الكائنات البيولوجية، رغم توفيرها حاليًا نتائج أفضل بكثير من البشر في بعض المناطق”.

ويذكر أن أحد التعريفات الأكثر مثالية للتكنولوجيا هو “التكنولوجيا التي يتم إنشاؤها باستخدام أقل قدر من التكنولوجيا”.

كيرشجي يؤكد على أن “تطور صناعة الآلات والتكنولوجيا الرقمية، يحمل في طيّاته فرصًا كبيرة ومخاطر كبيرة أيضًا”.

وفي ما يتعلق بالتفاعل الإيجابي، يوضح أنه “يمكن تحقيق نتائج رائعة عندما يتم تحقيق التفاعل الصحيح مع الآلات، قد تنشأ مخاطر أيضًا عندما لا يتم إعداد التفاعل بشكل صحيح”.

ويكمل بأن “هذا الخطر قد يهدد الوجود البشري والطبيعة، لذلك فنحن لسنا الوحيدين المعرضين للخطر، بل إن الطبيعة معرضة للخطر أيضا”.

ويختم بالقول: “كل نوع من التكنولوجيا له إيجابياته وسلبياته، فعلى سبيل المثال، نحن بحاجة دائمة للطاقة الكهربائية، لكن الإنتاج غير المنضبط لهذه الطاقة يشكل خطرًا على الجميع”.

استخدامه في الحروب

استخدامات الذكاء الاصطناعي انتشرت في أكثر من مجال وقطاع، وتمكنت شركات التكنولوجيا من استقطاب 50 مليار دولار من الاستثمارات في العام 2023، بنمو فاق الـ70 بالمئة خلال الأعوام الخمسة الأخيرة.

ولم تسلم حتى الحروب من استخداماته، حيث حولت “إسرائيل” قطاع غزة إلى ميدان تجارب لاستخدامات الذكاء الاصطناعي في الحرب، حينما ضاعفت عدد الأهداف التي ضربتها في القطاع باستخدام الذكاء الاصطناعي.

ووفق الباحثة الفلسطينية العاملة في مجال أخلاقيات الذكاء الاصطناعي نور نعيم، في مقابلة سابقة مع الأناضول، فإن دولة الاحتلال ضربت 15 ألف هدف باستخدام تقنية الذكاء الاصطناعي المسماة “غوسبيل”، في أول 35 يوما من حربها المتواصلة على غزة منذ 7 أكتوبر/ تشرين الأول 2023.

وأشارت نعيم إلى أن هذا الرقم أعلى بكثير من عدد الأهداف التي ضُربت في العمليات السابقة بالمنطقة، حيث ضربت “إسرائيل” قرابة الستة آلاف هدف خلال حربها على غزة عام 2014 التي استمرت لمدة 51 يوما.